System działał, raporty powstawały, ale czas załadunku hurtowni rósł wykładniczo. Problem nie leżał w infrastrukturze ani w zapytaniach. Leżał w tym, że hurtownia danych w ogóle nie istniała jako fizyczna struktura.

- Wirtualna hurtownia danych oparta wyłącznie na widokach nie jest hurtownią

- Brak fizycznych tabel faktów i wymiarów prowadzi do eksplozji czasu ładowania

- Optymalizacja zapytań nie zastąpi właściwego modelowania wymiarowego

- Refaktoryzacja modelu danych może dać wzrost wydajności o kilka rzędów wielkości

Pozory normalności

Historia zaczęła się standardowo. Klient zgłosił problem z wydajnością hurtowni danych opartej na SQL Server i Analysis Services. Czas załadunku kostki OLAP przekraczał osiem godzin i systematycznie rósł. Raporty działały coraz wolniej, użytkownicy narzekali, a zespół IT próbował różnych optymalizacji bez widocznych efektów.

Pierwszym odruchem było sprawdzenie infrastruktury. CPU wykorzystane w 30%, pamięć wystarczająca, dyski SSD o przyzwoitych parametrach IOPS. Konfiguracja SQL Server również wyglądała poprawnie: MAXDOP ustawione sensownie, pamięć przydzielona prawidłowo, tempdb rozłożone na wiele plików. Wszystkie typowe punkty kontrolne wyglądały dobrze.

Dopiero głębsza analiza planów wykonania zapytań i monitorowanie za pomocą Extended Events ujawniły rzeczywisty problem. System wykonywał te same skomplikowane operacje tysiące razy podczas każdego załadunku. Nie chodziło o pojedyncze wolne zapytanie, ale o fundamentalny błąd architektoniczny.

Anatomia pozornej hurtowni

Analiza struktury bazy danych pokazała zaskakujący obraz. Zamiast klasycznego modelu wymiarowego z tabelami faktów i wymiarów, znalazłem kilkadziesiąt widoków. Każdy widok zawierał rozbudowaną logikę biznesową: joiny między pięcioma, sześcioma, czasem nawet dziesięcioma tabelami źródłowymi, agregacje, funkcje analityczne, konwersje typów i warunki filtrowania.

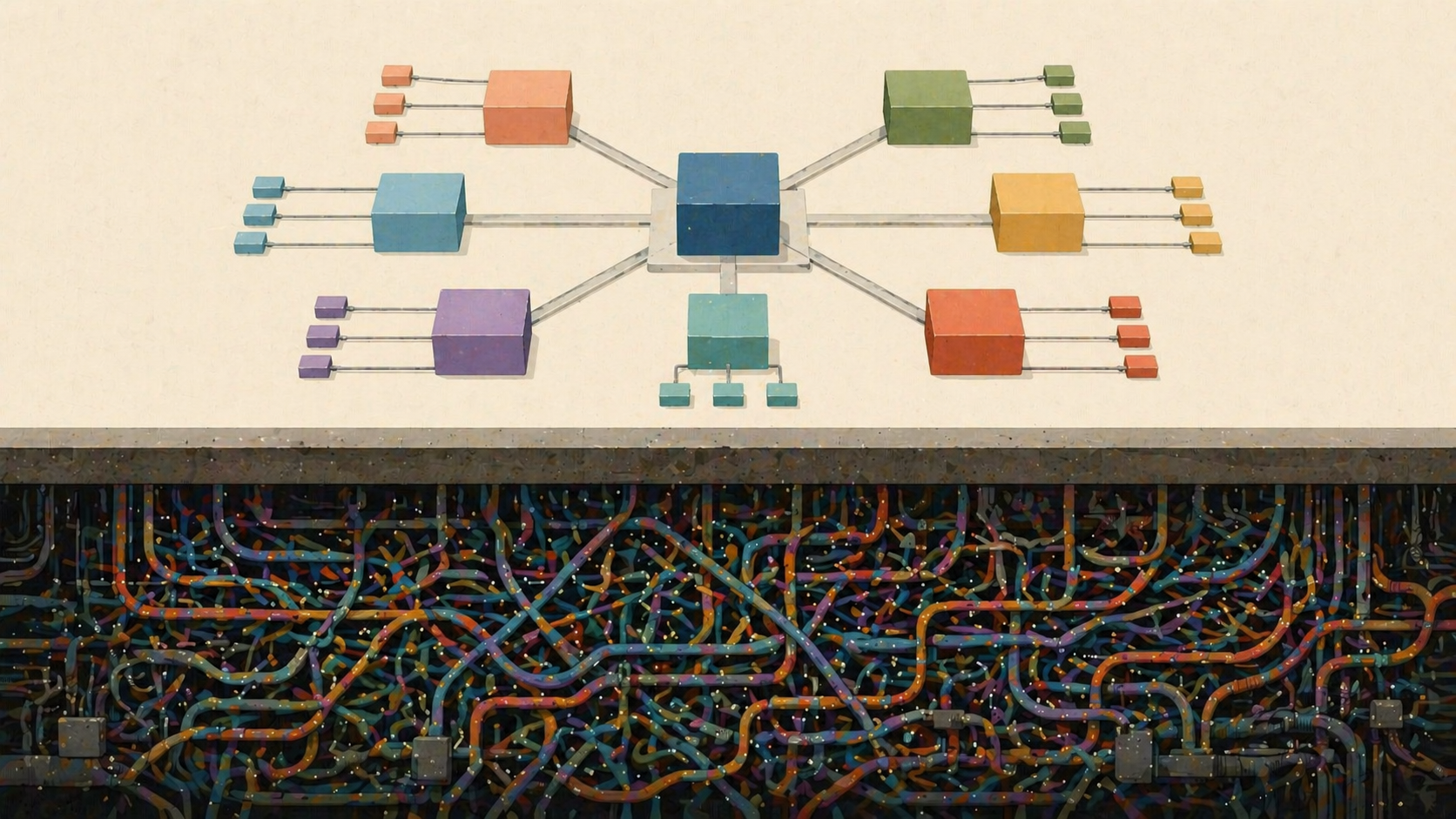

W Data Source View narzędzia Analysis Services te widoki zostały połączone relacjami i prezentowane jako model danych. Wizualnie wyglądało to jak schemat gwiazdy. Problem polegał na tym, że to była tylko wizualizacja, a nie rzeczywista struktura.

Czym naprawdę jest Data Source View

Data Source View w Analysis Services pełni konkretną funkcję: stanowi warstwę abstrakcji między fizyczną bazą danych a modelem analitycznym. Pozwala definiować nazwane zapytania, ukrywać niepotrzebne kolumny i tworzyć obliczenia. Kluczowe jest jednak to, że DSV powinno odwzorowywać istniejący model danych, a nie zastępować go.

W opisywanym przypadku DSV stało się jedynym miejscem, gdzie model istniał. Nie było żadnych tabel wymiarowych w bazie. Nie było tabeli faktów z kluczami obcymi. Były tylko widoki, które za każdym razem obliczały wszystko od zera na podstawie tabel operacyjnych.

Widziałem wiele błędów architektonicznych w swojej karierze, ale ten należy do najbardziej kosztownych. Zespół spędził tygodnie na optymalizacji zapytań, które z definicji nie mogły działać wydajnie. To jak próba przyspieszenia samochodu bez silnika poprzez malowanie go na czerwono.

Mechanizm lawinowego wzrostu kosztów

Żeby zrozumieć skalę problemu, trzeba prześledzić co działo się podczas załadunku kostki OLAP. Analysis Services musi przetworzyć każdy wymiar i każdą grupę miar. Dla każdego wymiaru wykonuje zapytanie pobierające wszystkich członków. Dla każdej partycji faktów wykonuje zapytanie pobierające dane.

Gdy źródłem jest widok zawierający pięć joinów i agregację, każde takie zapytanie wymusza pełne wykonanie całej logiki. Przy dwudziestu wymiarach i dziesięciu partycjach to już trzydzieści wykonań tego samego kosztownego kodu. Dodajmy do tego zapytania walidacyjne, przetwarzanie relacji i aktualizacje agregacji.

Problem UNKNOWN MEMBER

Brak fizycznych relacji między tabelami w bazie prowadził do kolejnego problemu. Analysis Services nie mogło poprawnie rozpoznać powiązań między faktami a wymiarami. W efekcie generowało ogromne ilości rekordów UNKNOWN MEMBER, czyli faktów, których nie udało się powiązać z żadnym członkiem wymiaru.

W bazie widziałem wymiary z 50% rekordów przypisanych do UNKNOWN MEMBER. Każdy taki rekord to dodatkowe obciążenie podczas przetwarzania i późniejszych zapytań. Co gorsza, raporty pokazywały zafałszowane dane, bo znaczna część miar lądowała w kategorii nieznane.

Brak strategii przyrostowej

Kolejnym czynnikiem pogarszającym sytuację było pełne przetwarzanie przy każdym załadunku. Bez fizycznego modelu z oznaczeniem rekordów nowych i zmodyfikowanych nie dało się zaimplementować ładowania przyrostowego. System codziennie przetwarzał miliony rekordów, z których 99% nie uległo zmianie.

W przypadku kostki OLAP oznaczało to ProcessFull zamiast ProcessUpdate. Różnica w czasie wykonania potrafiła być dziesięciokrotna.

Właściwe rozwiązanie

Rozwiązanie problemu wymagało fundamentalnej przebudowy, a nie kosmetycznych poprawek. Prace podzieliliśmy na trzy fazy.

Faza pierwsza: ekstrakcja logiki do ETL

Pierwszym krokiem było przeniesienie całej logiki biznesowej z widoków do procesu ETL. Wykorzystaliśmy SQL Server Integration Services, choć równie dobrze sprawdziłby się Azure Data Factory czy inne narzędzie ETL.

Kluczowa zmiana polegała na tym, że skomplikowane joiny, agregacje i transformacje wykonywały się raz podczas nocnego załadunku. Wynik trafiał do fizycznych tabel, które potem służyły jako źródło dla kostki OLAP.

Sama ta zmiana skróciła czas przetwarzania o połowę, mimo że nadal nie mieliśmy optymalnego modelu danych.

Faza druga: budowa fizycznego modelu Star Schema

Właściwa praca polegała na zaprojektowaniu i zbudowaniu rzeczywistego modelu wymiarowego. Stworzyliśmy tabele wymiarowe z kluczami sztucznymi typu integer, atrybutami opisowymi i odpowiednimi indeksami. Tabele faktów otrzymały klucze obce do wymiarów oraz indeks klastrowy na kolumnie daty.

Przykładowa struktura wymiaru klienta wyglądała następująco:

- DimCustomer_SK jako klucz sztuczny (identity)

- CustomerBusinessKey jako klucz naturalny ze źródła

- Atrybuty opisowe: nazwa, segment, region, data rejestracji

- Kolumny SCD: ValidFrom, ValidTo, IsCurrent dla obsługi historii

- Indeks klastrowy na kluczu sztucznym

- Indeks nieklastrowy na kluczu naturalnym

Tabela faktów sprzedaży zawierała wyłącznie klucze obce do wymiarów oraz miary liczbowe. Żadnej logiki, żadnych obliczeń, tylko czyste dane gotowe do agregacji.

Faza trzecia: uporządkowanie przepływu danych

Ostatnim elementem było wdrożenie architektury warstwowej zgodnej z podejściem Medallion. Dane przechodziły przez trzy wyraźne etapy:

- Warstwa Bronze: surowe dane ze źródeł, bez transformacji, z pełną historią ładowań

- Warstwa Silver: dane oczyszczone, ujednolicone typy, obsłużone wartości NULL, deduplikacja

- Warstwa Gold: model wymiarowy Star Schema, gotowy do konsumpcji przez kostki OLAP i raporty

Każda warstwa miała jasno określoną odpowiedzialność. Debugowanie problemów stało się znacznie prostsze, bo mogliśmy sprawdzić stan danych na każdym etapie.

Wymierne rezultaty

Po wdrożeniu wszystkich zmian czas załadunku hurtowni spadł z ośmiu godzin do czterdziestu minut. Samo przetwarzanie kostki OLAP skróciło się z czterech godzin do piętnastu minut. Wprowadzenie ładowania przyrostowego pozwoliło na odświeżanie danych co godzinę zamiast raz dziennie.

Równie istotna była poprawa jakości danych. Liczba rekordów UNKNOWN MEMBER spadła praktycznie do zera. Raporty zaczęły pokazywać spójne i wiarygodne informacje.

Lekcje na przyszłość

Ten przypadek ilustruje szerszy problem, który spotykam regularnie. Narzędzia takie jak Analysis Services czy Power BI są na tyle elastyczne, że pozwalają budować rozwiązania bez właściwego fundamentu. Wizualnie wszystko wygląda dobrze, system działa, raporty powstają. Problemy ujawniają się dopiero przy skalowaniu.

Kluczowe zasady, które warto zapamiętać:

- Data Source View odwzorowuje model, nie zastępuje go

- Logika biznesowa należy do warstwy ETL, nie do widoków odpytywanych wielokrotnie

- Model wymiarowy wymaga fizycznych tabel z relacjami i indeksami

- Każda warstwa architektury powinna mieć jedną odpowiedzialność